The Efficiency Era: ยุคแห่งการเค้นประสิทธิภาพ AI

ผู้เขียน : ดร.ณรงค์ บริจินดากุล Technical Specialist ที่ SCB 10X

ข่าวที่เกี่ยวข้อง

สัปดาห์ที่ผ่านมาผู้เขียนได้มีโอกาสร่วมงาน NVIDIA GTC ที่ San Jose และพบ trend หนึ่งที่ค่อนข้างชัดเจน นั่นคือการเปลี่ยน mindset จากการเน้น scaling โมเดลให้ใหญ่ขึ้น มาเป็นการหันกลับมา optimize ในมุมต่าง ๆ เพื่อเค้นประสิทธิภาพจากทรัพยากรที่มีอยู่ โดยโฟกัสจะอยู่ที่ efficiency ซึ่ง trend นี้ปรากฏขึ้นพร้อมกันทั้งทางฝั่ง software และ hardware

ฝั่ง Software

Yang Zhilin ผู้ก่อตั้ง Moonshot AI (บริษัทที่อยู่เบื้องหลัง Kimi) ขึ้นเวทีเล่างานวิจัยที่ทำกับ Kimi 2.5 โดยมีจุดสำคัญอยู่ 3 จุด หากดูผิวเผินอาจเหมือนคนละเรื่อง แต่แท้จริงแล้วล้วนตอบโจทย์เดียวกัน นั่นก็คือ efficiency

ประเด็นแรกคือ Token efficiency ก่อนอื่นต้องเข้าใจก่อนว่า "token" คือหน่วยพื้นฐานที่ AI ใช้ในการอ่านและสร้างภาษา อาจเป็นคำ พยางค์ หรือชิ้นส่วนของคำก็ได้ ยิ่ง AI ต้องประมวลผลหรือสร้าง token มากเท่าไหร่ ก็ยิ่งใช้พลังประมวลผลและต้นทุนมากขึ้นเท่านั้น

Token efficiency จึงหมายถึงการพยายามเค้น intelligence ให้ได้มากขึ้นจากงบประมาณด้าน compute (พลังประมวลผล) และ data เท่าเดิม ผ่านตัว Muon optimizer ซึ่งเป็นเทคนิคที่ช่วยปรับจูนกระบวนการเรียนรู้ของโมเดลให้มีประสิทธิภาพมากขึ้น เปรียบเสมือนครูฝึกที่เก่งขึ้น สอนนักเรียนคนเดิมด้วยตำราเดิม แต่ได้ผลลัพธ์ดีกว่าเดิมเกือบ 2 เท่า จุดสำคัญคือไม่ใช่ "เน้นแต่ scale ทุกอย่างให้ใหญ่ขึ้น" แต่เป็น "เค้นจาก resource ที่มีอยู่ให้ได้มากขึ้น" เปรียบเทียบง่ายๆ คือสมมุติเดิมส้ม 1 ลูกเค้นน้ำได้ 1 แก้ว ในยุคที่มีส้มเหลือเฟือก็ไม่มีปัญหา แต่ในยุคที่ส้มมีจำกัด (ในที่นี้คือ data ที่มีคุณภาพสำหรับสอน AI เริ่มหาได้ยากขึ้น) คำถามคือเราจะเค้นส้ม 1 ลูกให้ได้น้ำส้ม 2 แก้วได้อย่างไร

ประเด็นที่สองคือ Long context reasoning หรือการทำให้โมเดลคิดได้ยาวและซับซ้อนขึ้นโดยที่ต้นทุนไม่พุ่งสูงเกินไป เพื่อให้เห็นภาพ ปกติเวลาเราคุยกับ AI เราจะส่งข้อมูลเข้าไปในสิ่งที่เรียกว่า "context window" ซึ่งเปรียบเสมือนโต๊ะทำงานของ AI ยิ่งโต๊ะใหญ่ AI ก็ยิ่งวางเอกสารได้มากและเข้าใจบริบทได้ลึกขึ้น แต่ปัญหาคือยิ่งโต๊ะใหญ่ก็ยิ่งแพง ทั้งค่าไฟ ค่าเครื่อง และเวลาในการประมวลผล

Approach ของ Yang Zhilin คือ Kimi Linear ซึ่งเป็น hybrid architecture ที่ผสมเทคนิคการประมวลผลแบบประหยัดเข้ากับแบบเต็มกำลังในอัตราส่วนประมาณ 3:1 เปรียบเทียบได้กับการอ่านหนังสือทั้งเล่ม แทนที่จะอ่านทุกบรรทัดอย่างละเอียดเท่ากันหมด ก็เลือกอ่านคร่าวๆ เป็นส่วนใหญ่ แล้วค่อยอ่านละเอียดเฉพาะจุดที่สำคัญจริงๆ ผลลัพธ์คือ AI ทำงานเร็วขึ้น 5-6 เท่า โดยเป้าหมายไม่ใช่เพียงให้ AI รับข้อมูลได้มากขึ้น แต่เป็นการทำให้ "การคิดยาวๆ" ของ AI คุ้มค่าทางเศรษฐกิจจริง ไม่ใช่แค่ทำได้แต่แพงเกินกว่าจะใช้จริง

ประเด็นที่สามคือ Agent swarms เพื่ออธิบายให้เข้าใจ ปัจจุบัน AI ไม่ได้ทำงานเป็นแค่ chatbot ที่ตอบคำถามอย่างเดียวอีกต่อไป แต่สามารถทำหน้าที่เป็น "agent" หรือตัวแทนอัจฉริยะ ที่รับเป้าหมายแล้วลงมือทำงานหลายขั้นตอนด้วยตัวเอง เช่น ค้นข้อมูล วิเคราะห์ เขียนรายงาน ส่งอีเมล โดยไม่ต้องรอคำสั่งทีละขั้น

Agent swarms คือการนำ agent หลายตัวมาทำงานพร้อมกันเพื่อแก้ปัญหาที่ซับซ้อนภายในเวลาที่ไม่นานจนเกินไป approach ที่ Kimi ใช้คือการเทรน RL agent (สอน AI ผ่านการลองผิดลองถูกซ้ำๆ แล้วให้คะแนน) ให้ทำหน้าที่เป็น orchestrator หรือเปรียบเทียบได้กับการฝึก "หัวหน้าทีม" ให้เชี่ยวชาญเรื่องการมอบหมายงาน โดยให้มันลองแบ่งงานและจ่ายงานให้ agent ตัวอื่นๆ แล้วประเมินว่าทีมสามารถแก้ปัญหาที่ซับซ้อนได้หรือไม่ หากหัวหน้าแจกงานถูกคนถูกเรื่อง ทั้งทีมก็ทำงานเสร็จเร็วและแม่นยำ หากแจกงานผิด ทั้งทีมก็ช้าและพลาด เพราะ agent ที่แก้ปัญหาได้แต่ใช้เวลาเป็นวันก็คงไม่ทันต่อการใช้งานจริง

ทั้งสาม technical bets แม้จะต่างกัน แต่ตั้งอยู่บนโจทย์เดียวกันคือการรีด efficiency ให้ได้ของมากขึ้นจากทรัพยากรที่จำกัด ได้แก่ intelligence มากขึ้นจาก data ที่จำกัด, reasoning มากขึ้นจาก compute ที่จำกัด, และแก้ปัญหาที่ซับซ้อนได้มากขึ้นในเวลาที่จำกัด

ฝั่ง Hardware

การเปลี่ยนแปลงในทิศทางเดียวกันกำลังเกิดขึ้นในฝั่ง silicon เช่นกัน

หลายปีที่ผ่านมา วิวัฒนาการของ GPU (ชิปประมวลผลที่เป็นหัวใจของ AI) ค่อนข้างตรงไปตรงมา คือเพิ่มความเร็วในการคำนวณ เพิ่มหน่วยความจำ เพิ่มความเร็วในการรับส่งข้อมูล กล่าวคือเพิ่มทุกอย่างให้มากขึ้นและใหญ่ขึ้นเรื่อยๆ ซึ่งก็สมเหตุสมผล เพราะก่อนหน้านี้เราอยู่ในยุค pre-training scaling ที่การสอน AI ระดับแนวหน้าต้องการพลังประมวลผลมหาศาลแบบดุดัน คอขวดคือพลังในการประมวลผลล้วนๆ

แต่ปัจจุบัน workload ได้เปลี่ยนไปแล้ว เรากำลังเข้าสู่ยุค inference หรือยุคที่โฟกัสไม่ใช่การ "สอน" AI อีกต่อไป แต่เป็นการ "ใช้งาน" AI ให้มีประสิทธิภาพสูงสุด โมเดลสมัยนี้ไม่ได้แค่ตอบคำถามทันทีอีกแล้ว แต่ "คิดเป็นขั้นตอน" ก่อนตอบ (chain of thought) และ agents ก็รันงานหลายขั้นตอนต่อเนื่องกัน คอขวดจึงไม่ใช่เพียงแค่ชิปคำนวณเร็วเท่าไหร่อีกต่อไป แต่เป็นเรื่องของการสร้างคำตอบออกมาได้ efficient เพียงใด และ orchestrate กระบวนการที่ซับซ้อนได้ดีแค่ไหน

เพื่อให้เห็นภาพชัดขึ้น ปกติเวลา AI ทำงานจะแบ่งออกเป็น 2 ช่วง ช่วงแรกคือ "prefill" ซึ่งเป็นตอนที่ AI อ่านและประมวลผลคำถามทั้งหมดของผู้ใช้พร้อมกันทีเดียว เหมือนนักเรียนที่อ่านโจทย์ข้อสอบทั้งข้อให้จบก่อน ช่วงที่สองคือ "decode" ซึ่งเป็นตอนที่ AI เริ่มเขียนคำตอบออกมาทีละคำ (ตัวอักษรที่ค่อยๆ ปรากฏขึ้นมาเวลาเราใช้ ChatGPT หรือ Claude) เหมือนนักเรียนที่เริ่มลงมือเขียนคำตอบทีละประโยค สองช่วงนี้ต้องการ hardware ที่มีจุดเด่นคนละแบบ ช่วงอ่านโจทย์ต้องการชิปที่ประมวลผลข้อมูลจำนวนมากได้พร้อมกัน ส่วนช่วงเขียนคำตอบต้องการชิปที่สร้างผลลัพธ์ออกมาได้เร็วและทันที

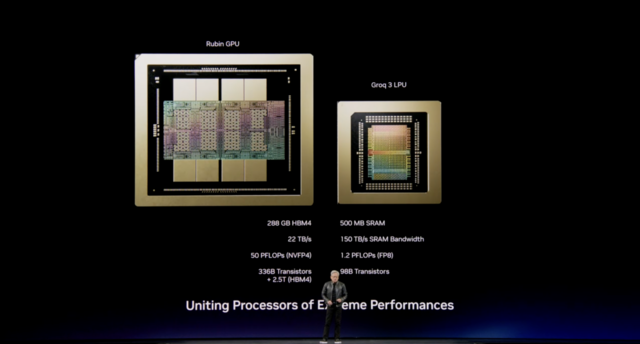

นี่คือเหตุผลที่หนึ่งใน move ที่น่าสนใจของ NVIDIA ในงาน GTC คือการนำ Groq 3 LPU มาเป็นส่วนหนึ่งของ Vera Rubin platform โดยให้ Rubin GPU รับผิดชอบช่วง prefill (อ่านโจทย์) ที่ต้องใช้พลังประมวลผลหนัก ส่วน Groq LPU ซึ่งใช้ memory ชนิดพิเศษที่มีความเร็วสูงกว่าปกติหลายเท่า (SRAM) มารับช่วง decode (เขียนคำตอบ) ที่ต้องสร้างผลลัพธ์ด้วยความหน่วงต่ำที่สุด Jensen Huang ระบุว่า combination นี้ให้ประสิทธิภาพในการสร้างคำตอบสูงกว่าเดิมถึง 35 เท่าต่อหน่วยพลังงาน ซึ่งนับเป็นผลิตภัณฑ์ระดับ rack (ตู้เซิร์ฟเวอร์) ตัวแรกของ NVIDIA ที่สร้างขึ้นรอบชิปที่ไม่ใช่ GPU

ที่สำคัญไม่ใช่เพียง NVIDIA เจ้าเดียวที่เดินในทิศทางนี้ ก่อนงาน GTC เพียงไม่กี่วัน AWS (บริการคลาวด์ของ Amazon) ก็ประกาศ collaboration กับ Cerebras ในแนวทางเดียวกัน คือให้ชิป Trainium ของ AWS รับช่วงอ่านโจทย์ ส่วนชิป Cerebras CS-3 รับช่วงเขียนคำตอบ เชื่อมต่อกันผ่านเครือข่ายความเร็วสูง

สอง platform ยักษ์ใหญ่ในวงการ AI มาบรรจบที่คำตอบทาง hardware architecture แบบเดียวกัน นั่นคือ "disaggregated inference" หรือการแยกส่วน hardware ตามหน้าที่เฉพาะทาง แทนที่จะใช้ชิปตัวเดียวทำทุกอย่าง เปรียบได้กับโรงงานที่เปลี่ยนจากการใช้เครื่องจักรหนึ่งเครื่องทำทุกขั้นตอน มาเป็นการแยกเครื่องจักรเฉพาะทางสำหรับแต่ละขั้นตอน ซึ่งเมื่อแต่ละเครื่องทำในสิ่งที่ตัวเองถนัดที่สุด ประสิทธิภาพรวมก็สูงขึ้นอย่างมาก

อีกประเด็นที่น่าสนใจคือบทบาทของ CPU ที่กลับมาสำคัญอีกครั้ง หากเปรียบ GPU เป็นกล้ามเนื้อที่ทำงานหนักในการคำนวณ CPU ก็เปรียบเสมือนสมองที่คอยสั่งการและประสานงาน Jensen Huang กล่าวอย่างชัดเจนว่า CPU ไม่ได้ทำหน้าที่เพียง support โมเดลอีกต่อไป แต่เป็นตัว "ขับเคลื่อนโมเดล" เนื่องจากระบบ agentic AI มีการสร้าง sub-agents หลายตัวที่ทำงานร่วมกันเป็นทีม แต่ละ agent ต้องเรียกใช้เครื่องมือต่างๆ ย้ายข้อมูล จัดการบริบท และประสานงานกับ agent ตัวอื่น ซึ่งงาน "ประสานงาน" เหล่านี้ล้วนเป็นหน้าที่ของ CPU ทั้งสิ้น

ทาง NVIDIA จึงเปิดตัว Vera CPU ที่ออกแบบมาเพื่อรองรับภารกิจนี้โดยเฉพาะ ด้วย 88 custom cores สามารถรองรับ agent environments (สภาพแวดล้อมการทำงานของ agent) ได้มากกว่า 22,500 ตัวพร้อมกัน ใน rack เดียว (ตู้เซิร์ฟเวอร์เดียว) ที่ประกอบด้วย 256 CPUs เปรียบเสมือนศูนย์บัญชาการที่สามารถสั่งการและประสานงานทีม agent ได้กว่า 22,500 ทีมพร้อมกันโดยไม่มีสะดุด

หากย้อนไปเพียงสองปีก่อน การบอกว่า CPU จะกลายเป็นโครงสร้างพื้นฐานที่สำคัญที่สุดของ AI คงฟังดูแปลก แต่เมื่อ agents เริ่มสร้าง agents ตัวอื่นต่อเป็นทอดๆ ชั้นของการประสานงานกลับกลายเป็นคอขวดแทนที่ชั้นของการคำนวณ

ขมวดปม

ยุค pre-training scaling เป็นยุคของการ "ใช้เงินแก้ปัญหา" ยิ่งมีข้อมูลสำหรับสอน AI มากก็ยิ่งดี พลังประมวลผลมากก็ยิ่งดี เงินยิ่งมากก็ยิ่งดี คนที่ได้เปรียบคือคนที่มีทรัพยากรมากที่สุด

แต่ยุคที่เรากำลังก้าวเข้าสู่นั้นแตกต่างออกไป จะเรียกว่ายุค efficiency scaling ก็ได้ เงินทุนยังคงมีความสำคัญอย่างยิ่ง เนื่องจากยังต้องใช้ชิปราคาสูง, data center ขนาดมหึมา และโครงสร้างพื้นฐานระดับพันล้านดอลลาร์ แต่เงินเพียงอย่างเดียวอาจไม่เพียงพออีกต่อไป เพราะหากการใช้ agent แก้ปัญหาสักครั้งมีต้นทุนสูงเกินไป ท้ายที่สุดก็จะไม่มีใครยินดีจ่าย

ผู้ที่ได้เปรียบในยุคนี้คือผู้ที่สามารถรีดเค้น intelligence ได้มากที่สุดต่อทุกบาทที่ลงทุนไป เกมจึงเปลี่ยนจาก "ใครจ่ายได้มากที่สุด" มาเป็น "ใครจ่ายได้ฉลาดที่สุด"

คำถามที่ตามมาคือ แล้วผู้ใช้งานอย่างเราจะได้ประโยชน์อะไร?

Efficiency gains ต่อ token น่าจะเพิ่มขึ้นอย่างต่อเนื่อง จากทั้ง hardware ที่เชี่ยวชาญเฉพาะทางมากขึ้น และ software ที่ฉลาดขึ้น ซึ่งพัฒนาควบคู่กันไป

อย่างไรก็ตาม สิ่งนี้ไม่ได้เป็นหลักประกันว่าต้นทุนรวมของ AI จะลดลง เพราะ agentic AI กำลังสร้างประเภทงานใหม่ๆ ที่ก่อนหน้านี้ไม่เคยมีมาก่อน ไม่ว่าจะเป็นการเขียนโค้ดแบบอัตโนมัติ การวิจัยแบบหลายขั้นตอน หรือการประสานงานข้ามเครื่องมือและบริการต่างๆ งานเหล่านี้ใช้ token มากกว่าการสนทนากับ chatbot ทั่วไปเป็นหลายสิบเท่า ต้นทุนต่อ token อาจลดลงก็จริง แต่ปริมาณ token ที่ถูกใช้งานกลับพุ่งสูงขึ้นอย่างมหาศาล

กล่าวอีกนัยหนึ่ง เราอาจกำลังเห็นปรากฏการณ์ที่เรียกว่า Jevons Paradox เวอร์ชัน compute Jevons Paradox เป็นแนวคิดทางเศรษฐศาสตร์จากศตวรรษที่ 19 ที่พบว่าเมื่อเครื่องจักรไอน้ำใช้ถ่านหินได้อย่างมีประสิทธิภาพมากขึ้น แทนที่ปริมาณการใช้ถ่านหินจะลดลง กลับเพิ่มขึ้นเพราะเครื่องจักรถูกนำไปใช้งานในรูปแบบใหม่ๆ ที่ก่อนหน้านี้ไม่คุ้มค่า ในทำนองเดียวกัน ยิ่ง inference มีประสิทธิภาพมากขึ้นเท่าใด ก็ยิ่ง unlock ให้เกิดรูปแบบการใช้งานใหม่ๆ ส่งผลให้ปริมาณการใช้งานเพิ่มขึ้นตามไปด้วย ท้ายที่สุดแม้ต้นทุนต่อหน่วยจะถูกลง แต่ยอดรวมที่เราจ่ายจริงก็อาจไม่ได้ลดลงเท่าที่คาดหวัง

ทว่าในทางกลับกัน ระบบเหล่านี้ก็เปิดทางให้เราสามารถแก้ปัญหาที่ซับซ้อนกว่าเดิมได้ ซึ่งเป็นปัญหาที่ในอดีตไม่สามารถแก้ไขได้เลย เพียงเปรียบเทียบสิ่งที่ทำได้ในยุค ChatGPT 3.5 ที่ตอบได้แค่คำถามง่ายๆ ทีละคำถาม กับสิ่งที่เราทำได้ด้วยเครื่องมืออย่าง Claude Cowork ในปัจจุบัน ที่สามารถรับมอบหมายงานทั้งชิ้นแล้วลงมือทำให้เสร็จ ทั้งขอบเขตของปัญหาที่ AI สามารถรับมือได้ และระดับความซับซ้อนที่จัดการได้ ล้วนแตกต่างกันอย่างมาก

ดร.ณรงค์ บริจินดากุล

Technical Specialist, SCB 10X